官方网站上《10 Minutes to pandas》的一个简单的翻译,原文在这里。这篇文章是对 pandas 的一个简单的介绍,详细的介绍请参考:秘籍 。习惯上,我们会按下面格式引入所需要的包:

1 | In [1]: import pandas as pd |

一、 创建对象

可以通过 数据结构入门 来查看有关该节内容的详细信息。

1、可以通过传递一个list对象来创建一个Series,pandas 会默认创建整型索引:

1 | In [4]: s = pd.Series([1,3,5,np.nan,6,8]) |

2、通过传递一个 numpyarray,时间索引以及列标签来创建一个DataFrame:

1 | In [6]: dates = pd.date_range('20130101', periods=6) |

3、通过传递一个能够被转换成类似序列结构的字典对象来创建一个DataFrame:

1 | In [10]: df2 = pd.DataFrame({ 'A' : 1., |

4、查看不同列的数据类型:

1 | In [12]: df2.dtypes |

5、如果你使用的是 IPython,使用 Tab 自动补全功能会自动识别所有的属性以及自定义的列,下图中是所有能够被自动识别的属性的一个子集:

1 | In [13]: df2.<TAB> |

二、 查看数据

详情请参阅:基础。

1、 查看DataFrame中头部和尾部的行:

1 | In [14]: df.head() |

2、 显示索引、列和底层的 numpy 数据:

1 | In [16]: df.index |

3、 describe()函数对于数据的快速统计汇总:

1 | In [19]: df.describe() |

4、 对数据的转置:

1 | In [20]: df.T |

5、 按轴进行排序

1 | In [21]: df.sort_index(axis=1, ascending=False) |

6、 按值进行排序

1 | In [22]: df.sort_values(by='B') |

三、 选择

虽然标准的 Python/Numpy 的选择和设置表达式都能够直接派上用场,但是作为工程使用的代码,我们推荐使用经过优化的 pandas 数据访问方式: .at, .iat, .loc, .iloc 和 .ix。详情请参阅索引和选取数据 和 多重索引/高级索引。

获取

1、 选择一个单独的列,这将会返回一个Series,等同于df.A:

1 | In [23]: df['A'] |

2、 通过[]进行选择,这将会对行进行切片

1 | In [24]: df[0:3] |

通过标签选择

1、 使用标签来获取一个交叉的区域

1 | In [26]: df.loc[dates[0]] |

2、 通过标签来在多个轴上进行选择

1 | In [27]: df.loc[:,['A','B']] |

3、 标签切片

1 | In [28]: df.loc['20130102':'20130104',['A','B']] |

4、 对于返回的对象进行维度缩减

1 | In [29]: df.loc['20130102',['A','B']] |

5、 获取一个标量

1 | In [30]: df.loc[dates[0],'A'] |

6、 快速访问一个标量(与上一个方法等价)

1 | In [31]: df.at[dates[0],'A'] |

通过位置选择

1、 通过传递数值进行位置选择(选择的是行)

1 | In [32]: df.iloc[3] |

2、 通过数值进行切片,与 numpy/python 中的情况类似

1 | In [33]: df.iloc[3:5,0:2] |

3、 通过指定一个位置的列表,与 numpy/python 中的情况类似

1 | In [34]: df.iloc[[1,2,4],[0,2]] |

4、 对行进行切片

1 | In [35]: df.iloc[1:3,:] |

5、 对列进行切片

1 | In [36]: df.iloc[:,1:3] |

6、 获取特定的值

1 | In [37]: df.iloc[1,1] |

快速访问标量(等同于前一个方法):

1 | In [38]: df.iat[1,1] |

布尔索引

1、 使用一个单独列的值来选择数据:

1 | In [39]: df[df.A > 0] |

2、 使用where操作来选择数据:

1 | In [40]: df[df > 0] |

3、 使用isin()方法来过滤:

1 | In [41]: df2 = df.copy() |

设置

1、 设置一个新的列:

1 | In [45]: s1 = pd.Series([1,2,3,4,5,6], index=pd.date_range('20130102', periods=6)) |

2、 通过标签设置新的值:

1 | In [48]: df.at[dates[0],'A'] = 0 |

3、 通过位置设置新的值:

1 | In [49]: df.iat[0,1] = 0 |

4、 通过一个numpy数组设置一组新值:

1 | In [50]: df.loc[:,'D'] = np.array([5] * len(df)) |

上述操作结果如下:

1 | In [51]: df |

5、 通过where操作来设置新的值:

1 | In [52]: df2 = df.copy() |

四、 缺失值处理

在 pandas 中,使用np.nan来代替缺失值,这些值将默认不会包含在计算中,详情请参阅:缺失的数据。

1、 reindex()方法可以对指定轴上的索引进行改变/增加/删除操作,这将返回原始数据的一个拷贝:

1 | In [55]: df1 = df.reindex(index=dates[0:4], columns=list(df.columns) + ['E']) |

2、 去掉包含缺失值的行:

1 | In [58]: df1.dropna(how='any') |

3、 对缺失值进行填充:

1 | In [59]: df1.fillna(value=5) |

4、 对数据进行布尔填充:

1 | n [60]: pd.isnull(df1) |

五、 相关操作

详情请参与 基本的二进制操作

统计(相关操作通常情况下不包括缺失值)

1、 执行描述性统计:

1 | In [61]: df.mean() |

2、 在其他轴上进行相同的操作:

1 | In [62]: df.mean(1) |

3、 对于拥有不同维度,需要对齐的对象进行操作。Pandas 会自动的沿着指定的维度进行广播:

1 | In [63]: s = pd.Series([1,3,5,np.nan,6,8], index=dates).shift(2) |

Apply

1、 对数据应用函数:

1 | In [66]: df.apply(np.cumsum) |

直方图

具体请参照:直方图和离散化。

1 | In [68]: s = pd.Series(np.random.randint(0, 7, size=10)) |

字符串方法

Series对象在其str属性中配备了一组字符串处理方法,可以很容易的应用到数组中的每个元素,如下段代码所示。更多详情请参考:字符串向量化方法。

1 | In [71]: s = pd.Series(['A', 'B', 'C', 'Aaba', 'Baca', np.nan, 'CABA', 'dog', 'cat']) |

六、 合并

Pandas 提供了大量的方法能够轻松的对Series,DataFrame和Panel对象进行各种符合各种逻辑关系的合并操作。具体请参阅:合并。

Concat

1 | In [73]: df = pd.DataFrame(np.random.randn(10, 4)) |

Join

类似于 SQL 类型的合并,具体请参阅:数据库风格的连接

1 | In [77]: left = pd.DataFrame({'key': ['foo', 'foo'], 'lval': [1, 2]}) |

另一个例子:

1 | In [82]: left = pd.DataFrame({'key': ['foo', 'bar'], 'lval': [1, 2]}) |

Append

将一行连接到一个DataFrame上,具体请参阅附加:

1 | In [87]: df = pd.DataFrame(np.random.randn(8, 4), columns=['A','B','C','D']) |

七、 分组

对于”group by”操作,我们通常是指以下一个或多个操作步骤:

(Splitting)按照一些规则将数据分为不同的组;

(Applying)对于每组数据分别执行一个函数;

(Combining)将结果组合到一个数据结构中;

详情请参阅:Grouping section

1 | In [91]: df = pd.DataFrame({'A' : ['foo', 'bar', 'foo', 'bar', |

1、 分组并对每个分组执行sum函数:

1 | In [93]: df.groupby('A').sum() |

2、 通过多个列进行分组形成一个层次索引,然后执行函数:

1 | In [94]: df.groupby(['A','B']).sum() |

八、 改变形状

Stack

1 | In [95]: tuples = list(zip(*[['bar', 'bar', 'baz', 'baz', |

1 | In [100]: stacked = df2.stack() |

1 | In [102]: stacked.unstack() |

数据透视表

详情请参阅:数据透视表.

1 | In [105]: df = pd.DataFrame({'A' : ['one', 'one', 'two', 'three'] * 3, |

可以从这个数据中轻松的生成数据透视表:

1 | In [107]: pd.pivot_table(df, values='D', index=['A', 'B'], columns=['C']) |

九、 时间序列

Pandas 在对频率转换进行重新采样时拥有简单、强大且高效的功能(如将按秒采样的数据转换为按5分钟为单位进行采样的数据)。这种操作在金融领域非常常见。具体参考:时间序列。

1 | In [108]: rng = pd.date_range('1/1/2012', periods=100, freq='S') |

1、 时区表示:

1 | In [111]: rng = pd.date_range('3/6/2012 00:00', periods=5, freq='D') |

2、 时区转换:

1 | In [116]: ts_utc.tz_convert('US/Eastern') |

3、 时间跨度转换:

1 | In [117]: rng = pd.date_range('1/1/2012', periods=5, freq='M') |

4、 时期和时间戳之间的转换使得可以使用一些方便的算术函数。

1 | In [123]: prng = pd.period_range('1990Q1', '2000Q4', freq='Q-NOV') |

十、 Categorical

从 0.15 版本开始,pandas 可以在DataFrame中支持 Categorical 类型的数据,详细 介绍参看:Categorical 简介和API documentation。

1 | In [127]: df = pd.DataFrame({"id":[1,2,3,4,5,6], "raw_grade":['a', 'b', 'b', 'a', 'a', 'e']}) |

1、 将原始的grade转换为 Categorical 数据类型:

1 | In [128]: df["grade"] = df["raw_grade"].astype("category") |

2、 将 Categorical 类型数据重命名为更有意义的名称:

1 | In [130]: df["grade"].cat.categories = ["very good", "good", "very bad"] |

3、 对类别进行重新排序,增加缺失的类别:

1 | In [131]: df["grade"] = df["grade"].cat.set_categories(["very bad", "bad", "medium", "good", "very good"]) |

4、 排序是按照 Categorical 的顺序进行的而不是按照字典顺序进行:

1 | In [133]: df.sort_values(by="grade") |

5、 对 Categorical 列进行排序时存在空的类别:

1 | In [134]: df.groupby("grade").size() |

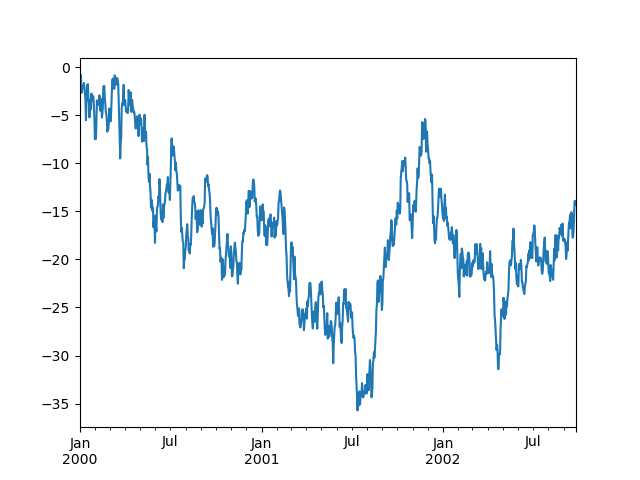

十一、 画图

具体文档参看:绘图文档。

1 | In [135]: ts = pd.Series(np.random.randn(1000), index=pd.date_range('1/1/2000', periods=1000)) |

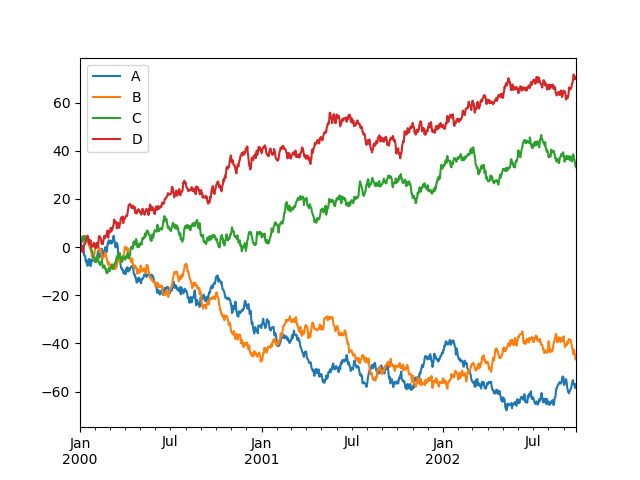

对于DataFrame来说,plot是一种将所有列及其标签进行绘制的简便方法:

1 | In [138]: df = pd.DataFrame(np.random.randn(1000, 4), index=ts.index, |

十二、 导入和保存数据

CSV

参考:写入 CSV 文件。

1、 写入 csv 文件:

1 | In [141]: df.to_csv('foo.csv') |

2、 从 csv 文件中读取:

1 | In [142]: pd.read_csv('foo.csv') |

HDF5

参考:HDF5 存储

1、 写入 HDF5 存储:

1 | In [143]: df.to_hdf('foo.h5','df') |

2、 从 HDF5 存储中读取:

1 | In [144]: pd.read_hdf('foo.h5','df') |

Excel

参考:MS Excel

1、 写入excel文件:

1 | In [145]: df.to_excel('foo.xlsx', sheet_name='Sheet1') |

2、 从excel文件中读取:

1 | In [146]: pd.read_excel('foo.xlsx', 'Sheet1', index_col=None, na_values=['NA']) |

十三、陷阱

如果你尝试某个操作并且看到如下异常:

1 | if pd.Series([False, True, False]): |

解释及处理方式请见比较。

同时请见陷阱。